4 A Distribuição Normal Multivariada

Até agora, discutimos os parâmetros de um vetor aleatório (\(\boldsymbol{\mu}\) e \(\boldsymbol{\Sigma}\)) sem assumir uma forma específica para sua distribuição de probabilidade. No entanto, para desenvolvermos uma teoria de inferência estatística robusta e compreendermos o funcionamento de muitas técnicas clássicas, precisamos de um modelo de distribuição de referência. Na análise multivariada, esse papel é desempenhado pela distribuição Normal Multivariada (NMV).

A NMV é uma generalização da distribuição normal (Gaussiana) para o caso de \(p\) variáveis. Ela é, de longe, a distribuição mais importante da análise multivariada, por várias razões: 1. Muitos fenômenos naturais podem ser aproximados pela NMV. 2. O Teorema do Limite Central, em sua forma multivariada, garante que a média de vetores aleatórios de (quase) qualquer distribuição tende a se comportar como uma NMV para amostras grandes. 3. Suas propriedades matemáticas são extremamente convenientes e bem compreendidas, o que facilita muito a derivação de resultados teóricos.

4.1 A Função de Densidade

Um vetor aleatório \(\mathbf{x}\) de dimensão \(p\) segue uma distribuição Normal Multivariada com vetor de médias \(\boldsymbol{\mu}\) e matriz de covariâncias \(\boldsymbol{\Sigma}\) (positiva definida), denotado por \(\mathbf{x} \sim N_p(\boldsymbol{\mu}, \boldsymbol{\Sigma})\), se sua função de densidade de probabilidade (FDP) for dada por:

\[ f(\mathbf{x}) = \frac{1}{(2\pi)^{p/2} |\boldsymbol{\Sigma}|^{1/2}} \exp\left( -\frac{1}{2} (\mathbf{x} - \boldsymbol{\mu})' \boldsymbol{\Sigma}^{-1} (\mathbf{x} - \boldsymbol{\mu}) \right) \]

Onde: - \(|\boldsymbol{\Sigma}|\) é o determinante da matriz de covariâncias. - \(\boldsymbol{\Sigma}^{-1}\) é a inversa da matriz de covariâncias.

Apesar de parecer intimidante, a estrutura da FDP é bastante lógica. O termo no expoente, \((\mathbf{x} - \boldsymbol{\mu})' \boldsymbol{\Sigma}^{-1} (\mathbf{x} - \boldsymbol{\mu})\), é uma forma quadrática que mede a “distância” do ponto \(\mathbf{x}\) ao centro \(\boldsymbol{\mu}\), ponderada pela estrutura de covariância \(\boldsymbol{\Sigma}\). Essa distância é chamada de distância de Mahalanobis. Quanto maior essa distância, menor o valor da função de densidade, o que faz todo o sentido.

4.2 Propriedades da Distribuição Normal Multivariada

A popularidade da NMV vem de suas propriedades elegantes:

Combinações Lineares: Se \(\mathbf{x} \sim N_p(\boldsymbol{\mu}, \boldsymbol{\Sigma})\), então qualquer combinação linear de suas componentes, \(\mathbf{a}'\mathbf{x} = a_1X_1 + \dots + a_pX_p\), segue uma distribuição normal univariada. Mais geralmente, se \(\mathbf{A}\) é uma matriz de constantes, então \(\mathbf{Ax}\) segue uma distribuição Normal Multivariada.

Distribuições Marginais: Qualquer subconjunto de variáveis de um vetor Normal Multivariado também segue uma distribuição Normal Multivariada. Por exemplo, se \(\mathbf{x} = [X_1, X_2, X_3]'\) é NMV, então o vetor \([X_1, X_3]'\) também é NMV.

Independência e Covariância Zero: Para a maioria das distribuições, covariância zero não implica independência. No entanto, para a NMV, essa implicação é verdadeira. Se um subconjunto de variáveis em um vetor NMV tem covariância zero com outro subconjunto, então esses dois subconjuntos são independentes. Esta é uma propriedade extremamente poderosa.

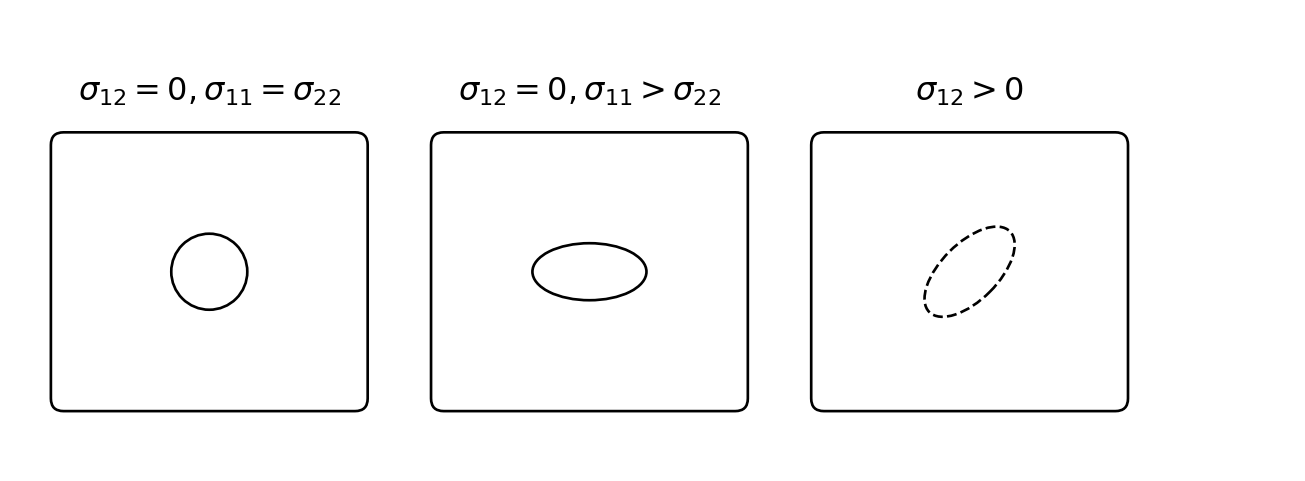

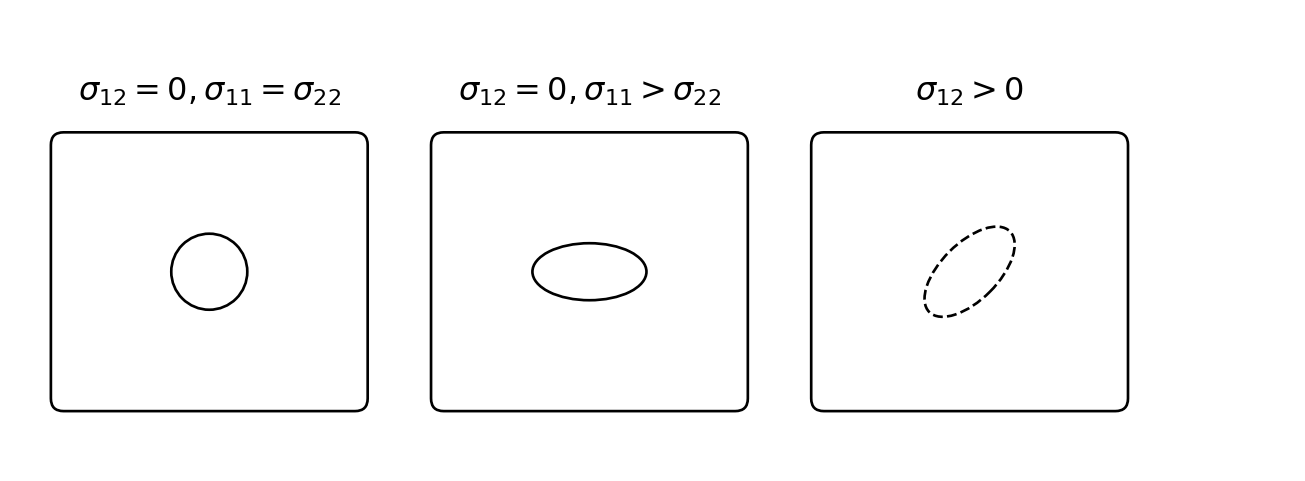

4.3 Visualizando a Normal Bivariada

Para ganhar intuição, é útil visualizar o caso bivariado (\(p=2\)). A função de densidade forma uma superfície em forma de sino no espaço 3D. Os contornos de densidade constante, quando projetados no plano \((x_1, x_2)\), formam elipses.

\[ (\mathbf{x} - \boldsymbol{\mu})' \boldsymbol{\Sigma}^{-1} (\mathbf{x} - \boldsymbol{\mu}) = c^2 \]

A forma e a orientação dessas elipses são inteiramente determinadas pela matriz de covariâncias \(\boldsymbol{\Sigma}\).

- Se \(\sigma_{12} = 0\) e \(\sigma_{11} = \sigma_{22}\): As variáveis são não correlacionadas (e, portanto, independentes) e têm a mesma variância. Os contornos são círculos.

- Se \(\sigma_{12} = 0\) e \(\sigma_{11} \neq \sigma_{22}\): As variáveis são não correlacionadas, mas com variâncias diferentes. Os contornos são elipses alinhadas com os eixos de coordenadas.

- Se \(\sigma_{12} \neq 0\): As variáveis são correlacionadas. Os contornos são elipses rotacionadas. A direção do eixo principal da elipse é determinada pelos autovetores de \(\boldsymbol{\Sigma}\), e o comprimento dos eixos é determinado pelos autovalores.

Essa conexão entre a álgebra da matriz \(\boldsymbol{\Sigma}\) e a geometria da distribuição de dados é um dos temas mais importantes da análise multivariada e será a base para a técnica de Componentes Principais, que exploraremos mais adiante.